9、Cascaded Diffusion Models for High Fidelity Image Generation

简介

主页:https://cascaded-diffusion.github.io/

Cascaded Diffusion Models 能够在类条件ImageNet生成挑战上生成高保真图像,而无需任何辅助图像分类器的帮助来提高样本质量

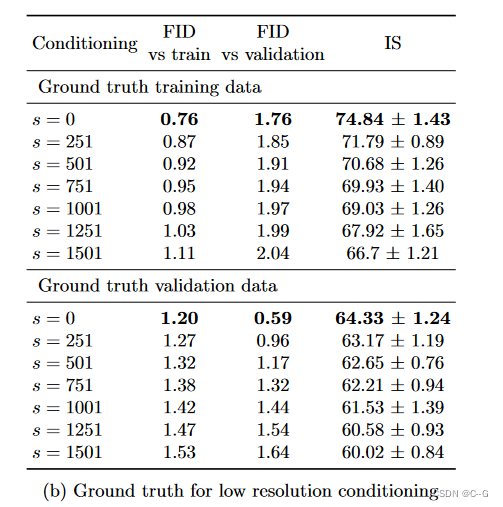

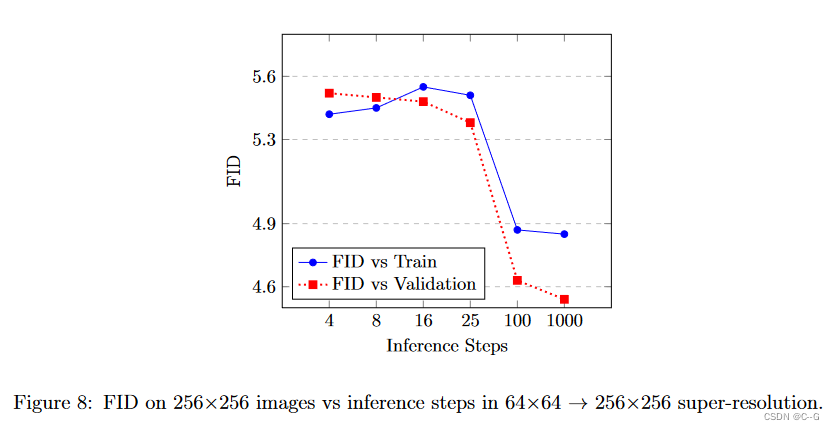

实验表明,样本质量关键依赖于条件增强,即提出的将低分辨率条件输入数据增强到超分辨率模型的方法

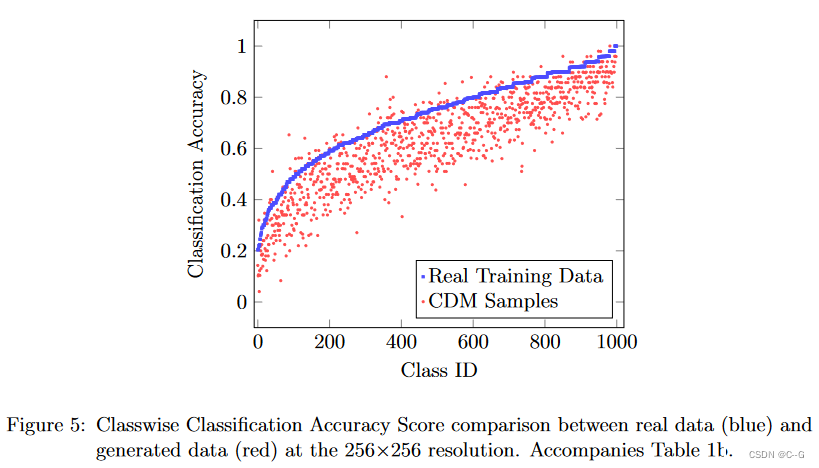

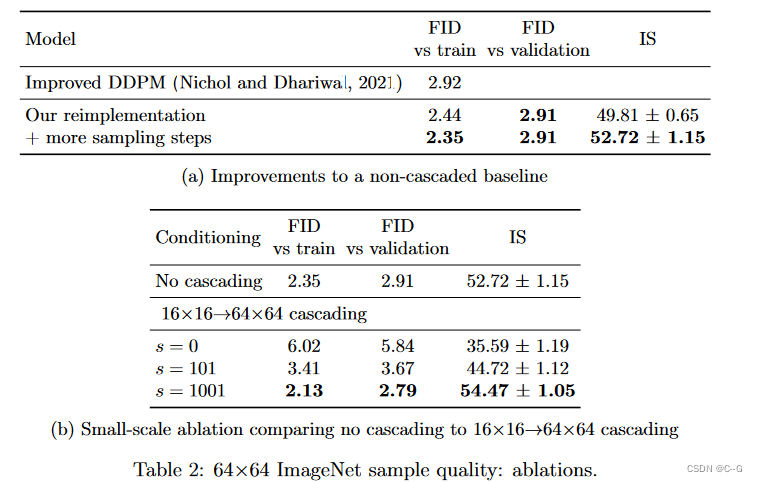

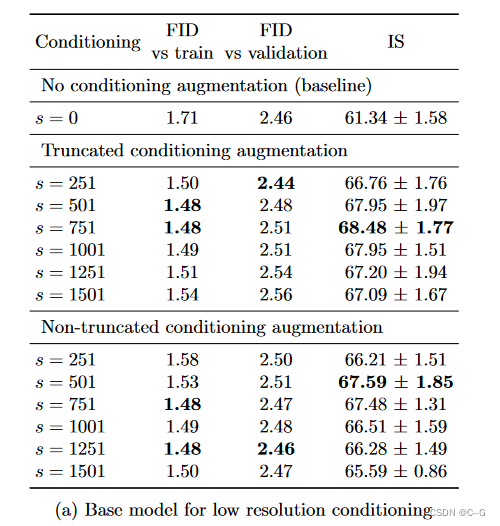

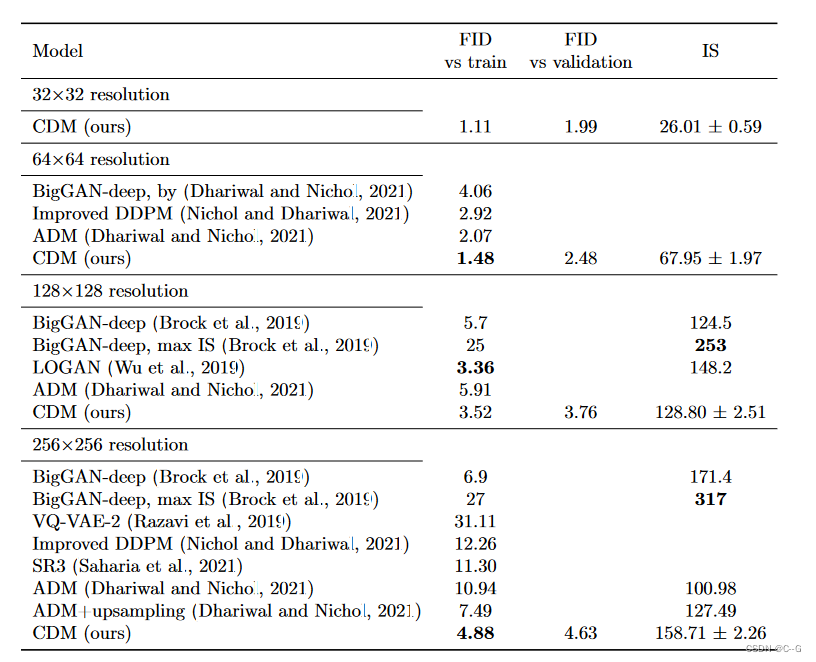

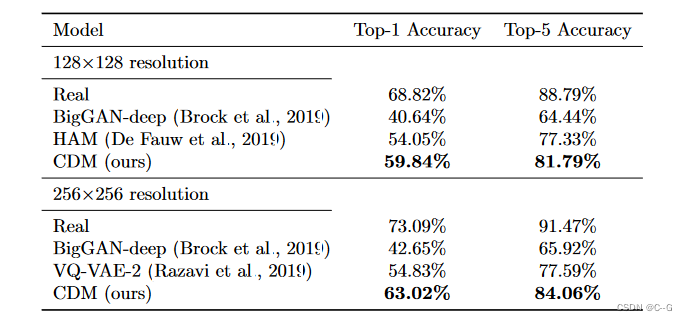

条件增强防止了Cascaded Diffusion Models采样过程中的复合误差,帮助训练级联管道,在64×64分辨率下FID得分为1.48,在128×128分辨率下为3.52,在256×256分辨率下为4.88,优于BigGAN-deep,在256×256分辨率下分类准确率得分为63.02% (top-1)和84.06% (top-5),优于VQ-VAE-2。

贡献点:

- Cascaded Diffusion Models(CDM)产生的高保真样本在FID评分和分类准确性评分方面优于BigGAN-deep和VQ-VAE-2,后者的差距很大。使用纯生成模型来实现这些结果,而不与任何分类器结合。

- 为超分辨率模型引入了条件增强,并发现它对实现高样本保真度至关重要。对增强策略进行了深入的探索,发现Gaussian augmentation 是低分辨率上采样的关键因素,而Gaussian blurring 是高分辨率上采样的关键因素。

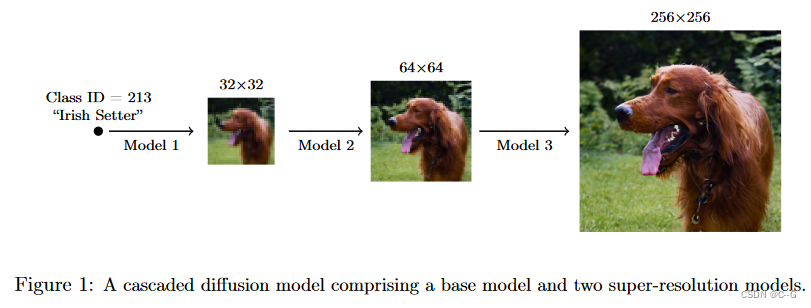

实现流程

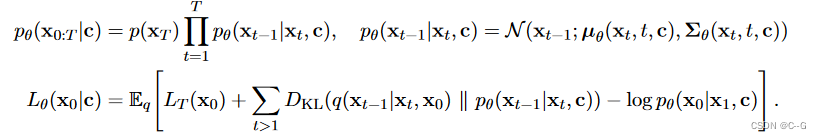

在条件生成设置中,数据 x0x_0x0 具有关联的条件信号 c

例如在类条件生成的情况下为标签,或在超分辨率的情况下为低分辨率图像

唯一需要对扩散模型做的修改是将 c 作为反向过程的输入:

与训练最高分辨率的标准模型相比,Cascaded Diffusion Models的一个主要好处是,大部分建模能力可以用于低分辨率,这在经验上对样本质量是最重要的,而且低分辨率的训练和采样往往是计算效率最高的

Cascaded Diffusion Models允许独立地训练各个模型,并且可以在每个特定分辨率上调整体系结构选择,以实现整个管道的最佳性能

conditioning augmentation

提高级Cascaded Diffusion Models样本质量的最有效技术是在每个超分辨率模型的低分辨率输入上使用数据增强来训练它

对于一些从低分辨率图像 z 到高分辨率图像 x0x_0x0 的超分辨率模型pθ(x0∣z)p_θ(x_0|z)pθ(x0∣z),条件增强是指对 z 应用某种形式的数据增强

在低分辨率下最有效的是添加高斯噪声(正向处理噪声),而对于高分辨率,随机对 z 应用高斯模糊

更实用的方法是训练超分辨率模型,并将其分摊到条件增强的强度上,并在训练后的超参数搜索中选择最佳强度,以获得最优的样本质量

Blurring Augmentation

条件增强的一个简单实例是通过模糊增强 z ,这对于上采样到分辨率为128×128和256×256的图像是最有效的,应用大小为 k 和 σ 的高斯滤波器来获得 zbz_bzb ,使用 k =(3,3) 的过滤器大小,并在训练过程中从固定范围随机采样 σ ,执行超参数搜索来找到 σ 的范围

训练过程,将这种模糊增强应用于50%的示例

验证过程,不对低分辨率输入施加增强

Truncated Conditioning Augmentation

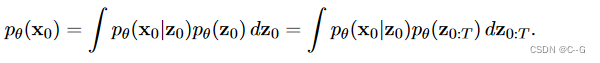

截断条件反射增强(truncated conditioning augmentation),一种条件增强的形式,它需要对超分辨率模型的训练和架构进行简单的修改,但在级联的初始阶段不需要对低分辨率模型进行更改,这种方法在分辨率小于128×128时最有用,生成高分辨率样本 x0x_0x0 需要首先从低分辨率模型pθ(z0)p_θ(z_0)pθ(z0) 生成 z0z_0z0,然后将结果输入超分辨率模型 pθ(x0∣z0)p_θ(x_0|z_0)pθ(x0∣z0)

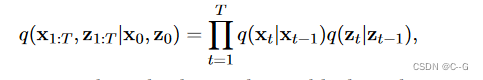

为了简单起见,假设低分辨率和超分辨率模型都使用相同数量的时间步长T

截断条件增强是指截断低分辨率反向过程,使其停止在时间步长 s > 0,而不是0,也就是说,低分辨率反向过程生成图像不需要迭代到 x0x_0x0,而是在给定的第 s 步停下,将 zsz_szs 作为高分辨率模块的条件输入

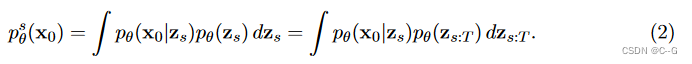

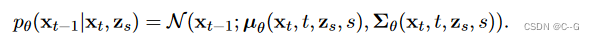

低分辨率模型为:pθ(zs)=∫pθ(zs:T)dzs+1:Tp_θ(z_s) = ∫ p_θ(z_{s:T} )d_{z_s+1:T}pθ(zs)=∫pθ(zs:T)dzs+1:T,超分辨率模型为:pθ(x0∣zs)=∫p(xT)∏t=1Tpθ(xt−1∣xt,zs)dx1:Tp_θ(x_0|z_s) = ∫ p(x_T ) ∏^T_{t=1} p_θ(x_{t−1}|x_t, z_s)d_{x_{1:T}}pθ(x0∣zs)=∫p(xT)∏t=1Tpθ(xt−1∣xt,zs)dx1:T

截断低分辨率反向过程是数据增强的一种形式的原因是:pθ(x0∣zs)p_θ(x_0|z_s)pθ(x0∣zs) 的$训练过程涉及到噪声 zsq(zs∣z0)z_s ~ q(z_s|z_0)zs q(zs∣z0) 的条件约束,该条件在缩放时,z0z_0z0 是高斯噪声增强的

将 psθ(x0)p_s^θ(x_0)psθ(x0) 视为具有扩散模型先验、扩散模型解码器和近似后验的VAE

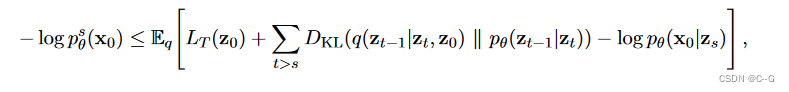

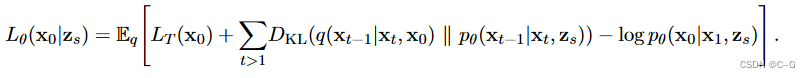

此时 ELBO 为

其中,LT(z0)=DKL(q(zT∣z0)‖p(zT))L_T (z_0) = D_{KL}(q(z_T |z_0) ‖ p(z_T ))LT(z0)=DKL(q(zT∣z0)‖p(zT))

t 的和 在 s 处被截断,解码器 pθ(x0∣zs)p_θ(x_0|z_s)pθ(x0∣zs) 是以 zsz_szs 为条件的超分辨率模型

解码器本身有一个ELBO −logpθ(x0∣zs)≤Lθ(x0∣zs)− log p_θ(x_0|z_s) ≤ L_θ(x_0|z_s)−logpθ(x0∣zs)≤Lθ(x0∣zs)

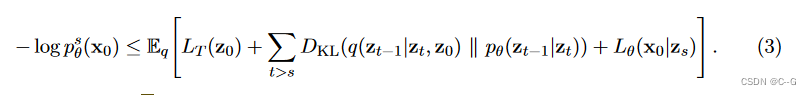

结合低分辨率和超分辨率模型,ELBO为

优化式(3)分别训练低分辨率模型和高分辨率模型

对于固定值 s,低分辨率过程被训练到截断时间步长 s

超分辨率模型是在一个条件信号上训练的,使用在时间步长停止的低分辨率正向处理

由于追求样本质量作为主要目标,当训练具有可学习的反向过程方差的模型时,不直接使用这些ELBO表达式,而是在它们的混合损失对应上进行训练

希望搜索 s 的多个值,以选择最佳的样本质量。为了使这种搜索切实可行,在训练时通过在均匀随机 s 上摊销单个超分辨率模型来避免重新训练模型。因为每个可能的截断时间对应于一个不同的超分辨率任务,μθμ_θμθ 和 ΣθΣ_θΣθ 的超分辨率模型必须将 zsz_szs 作为 s 的输入,这可以使用一个单独的网络来完成,并使用额外的时间嵌入 s 的输入。保持低分辨率模型训练不变,因为标准的扩散训练过程已经使用随机 s 进行训练。

Non-truncated Conditioning Augmentation

非截断条件反射增强(non-truncated conditioning augmentation),使用与截断条件反射增强相同的模型修改和训练过程,唯一的区别是采样时间,在非截断条件增强中,总是使用完整的、非截断的低分辨率反向过程对 z0z_0z0 进行采样,而不是截断低分辨率的反向过程

非截断条件增强相对于截断条件增强的主要优势是在搜索阶段对 s 的实际操作。在截断增强的情况下,如果想在所有 s 上并行运行超分辨率模型,必须存储所有考虑 s 值的所有低分辨率样本 zsz_szs。在非截断增强的情况下,只需要存储一次低分辨率的样本,因为采样 zs′∼q(zs∣z0)z'_s∼q(z_s|z_0)zs′∼q(zs∣z0) 在计算上是便宜的。

实验证明,截断和非截断条件增强的样本质量指标是相似的

实验

conclusion & limitation

Cascaded Diffusion Models在与条件增强(将数据增强引入超分辨率模型的条件信息中的技术)配对时,能够在ImageNet类条件生成基准上优于最先进的生成模型。在FID评分和分类精度评分方面,模型优于BigGAN-deep和VQ-VAE-2。

条件增强有助于样本质量,因为它对抗了由于超分辨率模型中训练-测试不匹配而导致的级联管道中的复合错误,并且提出了在不同水平的条件增强上平摊训练和测试模型的实用方法。虽然可能会以恶意使用图像生成的形式产生负面影响,但工作有潜力改善有益的下游应用,如数据压缩,同时推进基本机器学习问题的知识状态。认为结果是对扩散模型原始形式的图像合成能力的概念研究,只需要很少的额外技术