【Pytorch】使用Pytorch实现简单的Residual Network

创始人

2025-05-30 21:53:55

文章目录

- 1. 题目描述

- 2. 代码实现

- 验证

- 写在最后

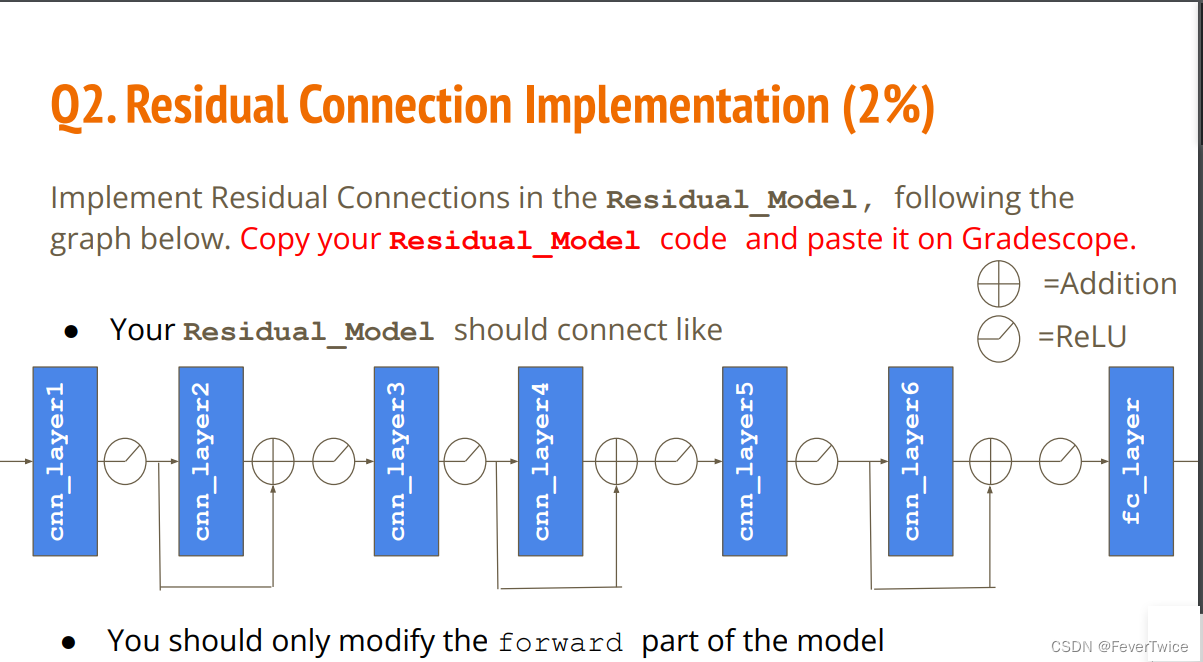

1. 题目描述

在这个例子中网络结构如下所示(网络结构取自李宏毅老师的HW3)

需要注意的是,当我们在计算卷积的特征图的维度时,常用以下公式:

OutputDim=(InputDim−KernelSize+2∗Padding)Stride+1OutputDim = \frac{(InputDim-KernelSize+2*Padding)}{Stride} + 1OutputDim=Stride(InputDim−KernelSize+2∗Padding)+1

- 当分子不能整除Stride的时候,输出维度默认向下取整,而对于MaxPooling的情况则相反(向上取整)

- kernel size, output dim, input dim 这些通常都只考虑正方形的输入输出,所以上面的公式只考虑一个维度即可

- stride对于卷积核的平移时,不论横轴还是纵轴都需要移动相同的stride

2. 代码实现

class MyResNet(nn.Module):def __init__(self):super(MyResNet, self).__init__()# input 128 * 128 * 3# Out = (Input - Kernel + 2 * Padding) / Stride + 1# layer1 O = (128 - 3 + 2)/1 + 1 = 128self.cnn_layer1 = nn.Sequential(nn.Conv2d(in_channels=3, out_channels=64, kernel_size=3, stride=1, padding=1),nn.BatchNorm2d(64))# layer2 O = (128 - 3 + 2)/1 + 1 = 128self.cnn_layer2 = nn.Sequential(nn.Conv2d(in_channels=64, out_channels=64, kernel_size=3, stride=1, padding=1),nn.BatchNorm2d(64))# layer3 O = (128 - 3 + 2)/2 + 1 = 64self.cnn_layer3 = nn.Sequential(nn.Conv2d(in_channels=64, out_channels=128, kernel_size=3, stride=2, padding=1),nn.BatchNorm2d(128))# layer4 O = (64 - 3 + 2)/1 + 1 = 64self.cnn_layer4 = nn.Sequential(nn.Conv2d(in_channels=128, out_channels=128, kernel_size=3, stride=1, padding=1),nn.BatchNorm2d(128))# layer5 O = (64 - 3 + 2)/2 + 1 = 32self.cnn_layer5 = nn.Sequential(nn.Conv2d(in_channels=128, out_channels=256, kernel_size=3, stride=2, padding=1),nn.BatchNorm2d(256))# layer6 O = (64 - 3 + 2)/1 +1 = 32self.cnn_layer6 = nn.Sequential(nn.Conv2d(in_channels=256, out_channels=256, kernel_size=3, stride=1, padding=1),nn.BatchNorm2d(256))# fcself.fc_layer = nn.Sequential(nn.Linear(32*32*256, 256),nn.ReLU(),nn.Linear(256, 11))self.relu = nn.ReLU()def forward(self, x):# 第一层不做加法,但是保存x1 = self.cnn_layer1(x)x1 = self.relu(x1)res1 = x1 # 第一层出来的作为残差记录# 第二层做加法x2 = self.cnn_layer2(x1)x2 = x2 + res1 # 第一次残差操作x2 = self.relu(x2)# 第三层不做加法,但是保存x3 = self.cnn_layer3(x2)x3 = self.relu(x3)res3 = x3# 第四层做加法x4 = self.cnn_layer4(x3)x4 = x4 + res3x4 = self.relu(x4)# 第五层不做加法,但是保存x5 = self.cnn_layer5(x4)x5 = self.relu(x5)res5 = x5# 第六层做加法x6 = self.cnn_layer6(x5)x6 = x6 + res5x6 = self.relu(x6)# 第七层全连接分类xout = x6.flatten(1) #(256,32,32) --> (256, 32*32)xout = self.fc_layer(xout)return xout

验证

随便找个图片数据集load进来就行,这里就不细说了

data_iter = iter(train_loader)

images, labels = next(data_iter) # 取出一个batchimage = images[0] # batch中的第一章图片

print(images.shape)

print(image.shape)image_np = np.transpose(image.numpy(), (1, 2, 0)) fig, ax = plt.subplots()

ax.imshow(image_np) # 其实是一个tensor

模型实例化

modeltest = MyResNet().to(device)

images, labels = next(data_iter) # 取出一个batchouts = modeltest(images.to(device))

运行了之后没报错就说明维度的输入输出没问题

写在最后

各位看官,都看到这里了,麻烦动动手指头给博主来个点赞8,您的支持作者最大的创作动力哟!

才疏学浅,若有纰漏,恳请斧正

本文章仅用于各位作为学习交流之用,不作任何商业用途,若涉及版权问题请速与作者联系,望悉知

相关内容

热门资讯

北京的名胜古迹 北京最著名的景...

北京从元代开始,逐渐走上帝国首都的道路,先是成为大辽朝五大首都之一的南京城,随着金灭辽,金代从海陵王...

苗族的传统节日 贵州苗族节日有...

【岜沙苗族芦笙节】岜沙,苗语叫“分送”,距从江县城7.5公里,是世界上最崇拜树木并以树为神的枪手部落...

世界上最漂亮的人 世界上最漂亮...

此前在某网上,选出了全球265万颜值姣好的女性。从这些数量庞大的女性群体中,人们投票选出了心目中最美...

长白山自助游攻略 吉林长白山游...

昨天介绍了西坡的景点详细请看链接:一个人的旅行,据说能看到长白山天池全凭运气,您的运气如何?今日介绍...

猫咪吃了塑料袋怎么办 猫咪误食...

你知道吗?塑料袋放久了会长猫哦!要说猫咪对塑料袋的喜爱程度完完全全可以媲美纸箱家里只要一有塑料袋的响...

怎么样的桃花 桃花近看远看的样...

今年的“三八”妇女节,阳光明媚,踏青赏花正当时。遂与姐妹们共赴十里蓝山,与花海来一场春天的约会。十里...

应用未安装解决办法 平板应用未...

---IT小技术,每天Get一个小技能!一、前言描述苹果IPad2居然不能安装怎么办?与此IPad不...

脚上的穴位图 脚面经络图对应的...

人体穴位作用图解大全更清晰直观的标注了各个人体穴位的作用,包括头部穴位图、胸部穴位图、背部穴位图、胳...

demo什么意思 demo版本...

618快到了,各位的小金库大概也在准备开闸放水了吧。没有小金库的,也该向老婆撒娇卖萌服个软了,一切只...

北京的名胜古迹 北京最著名的景...

北京从元代开始,逐渐走上帝国首都的道路,先是成为大辽朝五大首都之一的南京城,随着金灭辽,金代从海陵王...

苗族的传统节日 贵州苗族节日有...

【岜沙苗族芦笙节】岜沙,苗语叫“分送”,距从江县城7.5公里,是世界上最崇拜树木并以树为神的枪手部落...

怎么样的桃花 桃花近看远看的样...

今年的“三八”妇女节,阳光明媚,踏青赏花正当时。遂与姐妹们共赴十里蓝山,与花海来一场春天的约会。十里...

世界上最漂亮的人 世界上最漂亮...

此前在某网上,选出了全球265万颜值姣好的女性。从这些数量庞大的女性群体中,人们投票选出了心目中最美...

长白山自助游攻略 吉林长白山游...

昨天介绍了西坡的景点详细请看链接:一个人的旅行,据说能看到长白山天池全凭运气,您的运气如何?今日介绍...

猫咪吃了塑料袋怎么办 猫咪误食...

你知道吗?塑料袋放久了会长猫哦!要说猫咪对塑料袋的喜爱程度完完全全可以媲美纸箱家里只要一有塑料袋的响...

应用未安装解决办法 平板应用未...

---IT小技术,每天Get一个小技能!一、前言描述苹果IPad2居然不能安装怎么办?与此IPad不...

脚上的穴位图 脚面经络图对应的...

人体穴位作用图解大全更清晰直观的标注了各个人体穴位的作用,包括头部穴位图、胸部穴位图、背部穴位图、胳...

demo什么意思 demo版本...

618快到了,各位的小金库大概也在准备开闸放水了吧。没有小金库的,也该向老婆撒娇卖萌服个软了,一切只...